L’élection (ou réélection) de Donald Trump en 2024 a provoqué un véritable séisme dans l’écosystème des réseaux sociaux. Après la crise de confiance qui avait déjà secoué les plateformes en 2016, le sujet de la modération et de la circulation des fake news revient aujourd’hui sur le devant de la scène, plus brûlant que jamais. Les prises de position d’Elon Musk sur la « liberté d’expression » – matérialisées par le rachat de Twitter et son passage à la plateforme X – ou les récentes annonces de Mark Zuckerberg sur l’évolution de l’univers Meta alimentent de nouvelles controverses. Dans ce contexte, comment évaluer l’impact de ce « débridement » numérique sur le comportement des utilisateurs, et surtout, sur la jeunesse ? État des lieux, perspectives et enjeux de prévention.

État des lieux : un écosystème en ébullition

La victoire de Trump 2024 et l’essor de la « liberté d’expression » à tout prix

En surfant sur la vague populiste et conservatrice, Donald Trump a su mobiliser une partie de l’électorat en s’appuyant, entre autres, sur ses relais médiatiques en ligne. Cette nouvelle victoire a remis en avant le rôle des réseaux sociaux dans l’arène politique :

- Dérégulation accrue : En promettant de laisser davantage d’espace à tous types de discours, les réseaux sociaux les moins « bridés » attirent un public en quête de visibilité ou de messages musclés.

- Reprise en main par les politiques : Certains élus américains considèrent qu’il est nécessaire de réduire les barrières en matière de modération afin de préserver la « liberté d’expression ». À l’inverse, d’autres estiment que les plateformes doivent urgemment limiter la propagation de contenus violents, haineux ou mensongers.

Le tournant d’Elon Musk : de Twitter à X

Elon Musk, propriétaire actuel de l'ancien Twitter (rebaptisé X), a rapidement bouleversé les règles du jeu.

- Suspension et rétablissement de comptes : Sous prétexte d’encourager le débat libre, Musk a permis le retour de profils controversés, accusés auparavant de harcèlement ou de diffusion de fake news.

- Modération allégée : Les algorithmes et les équipes de modération ont vu leurs missions se redessiner, certains parlent même de « laisser-faire » ; la diffusion de contenus jugés extrêmes ou complotistes a ainsi grimpé en flèche.

- Stratégie de monétisation : Face à une baisse de confiance des annonceurs, Musk a opté pour de nouveaux modèles d’abonnements payants (X Premium). Les utilisateurs qui paient peuvent bénéficier d’une meilleure visibilité de leurs contenus, ce qui interroge sur la qualité de l’information mise en avant.

Mark Zuckerberg et ses nouvelles ambitions

Le patron de Meta (ex-Facebook) ne reste pas inactif face à cette concurrence et multiplie les annonces :

- Threads et le nouvel écosystème : Lancée en grande pompe, l’application Threads se positionne comme un concurrent direct de Twitter/X. Zuckerberg entend y développer un cadre « plus modéré » mais sans s’empêcher de jouer la carte du buzz.

- Focus sur le métavers et l’IA : Les annonces récentes portent sur l’intégration de l’intelligence artificielle dans le métavers et dans de nouveaux outils de modération automatiques. Toutefois, le manque de clarté sur la protection des données et la responsabilité de Meta en cas de dérives inquiète déjà les régulateurs.

Perspectives futures : vers quelles évolutions réglementaires et technologiques ?

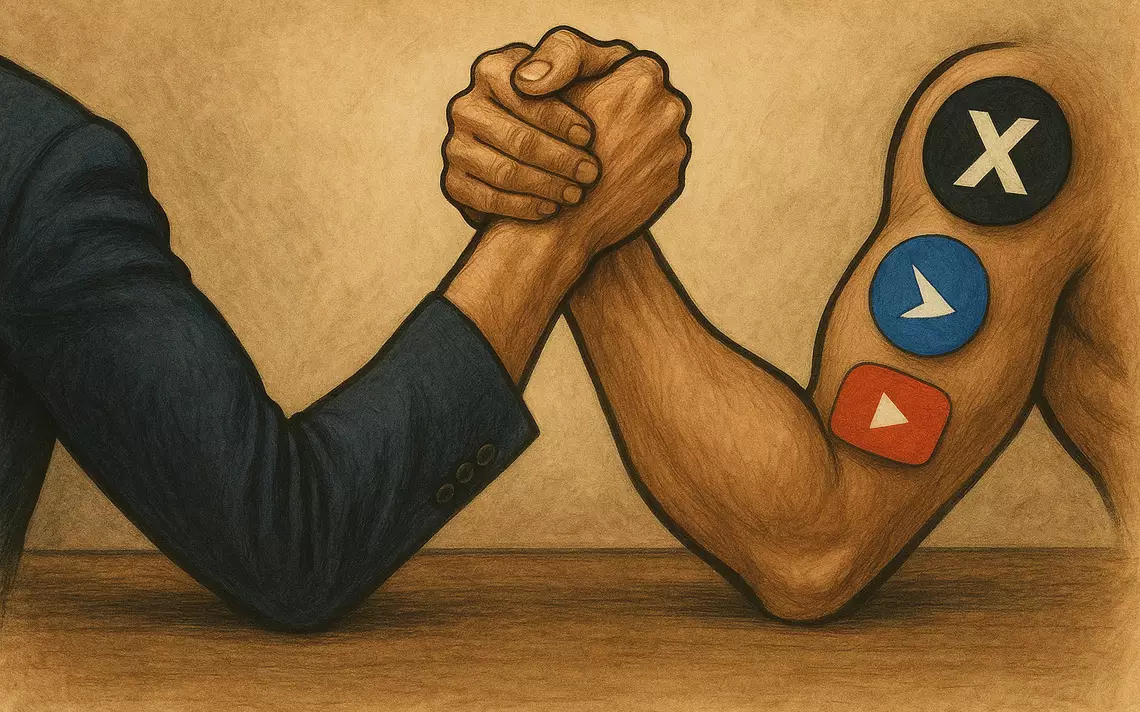

Un bras de fer entre gouvernements et plateformes

- La question de la régulation : À l’image du Digital Services Act (DSA) en Europe, les pouvoirs publics cherchent à imposer plus de transparence et de responsabilité aux plateformes. Aux États-Unis, le débat se cristallise autour de la Section 230 du Communications Decency Act, qui protège les réseaux sociaux des conséquences légales liées au contenu posté par leurs utilisateurs.

- Des mesures contradictoires : Tandis que certains réclament une surveillance accrue pour lutter contre la désinformation, d’autres estiment que la suppression de contenus ou la suspension de comptes relève d’une censure inacceptable. L’équilibre à trouver est extrêmement délicat et varie selon la sensibilité politique de chaque pays.

Le rôle croissant de l’intelligence artificielle

- Modération semi-automatisée : Les plateformes misent de plus en plus sur l’IA pour détecter et bloquer les discours haineux, le cyberharcèlement ou les fake news. Cependant, ces systèmes ne sont pas infaillibles et peuvent commettre des erreurs de classification, notamment en raison de biais.

- Personnalisation et filtrage : L’IA sert aussi à affiner le fil d’actualité et proposer des contenus susceptibles de « plaire » à l’utilisateur. Cette hyperpersonnalisation peut conduire à l’enfermement dans des bulles d’opinion, où la confrontation à la contradiction devient rare.

- Menaces sur les libertés : Certains craignent que l’usage d’IA au service de la surveillance ou de la censure puisse, à terme, restreindre la liberté d’expression. La question des dérives autoritaires se pose, surtout quand la frontière entre informations privées et publiques devient de plus en plus ténue.

Les enjeux de prévention et de sécurité pour la jeunesse

Des jeunes hyperconnectés et vulnérables

La génération Z et les plus jeunes (jusqu’à la génération Alpha) grandissent au milieu d’une offre pléthorique de plateformes. Du smartphone à la console de jeu en passant par la tablette, l’accès aux réseaux sociaux se fait 24h/24, ce qui entraîne :

- Risques d’addiction aux écrans : La quête de reconnaissance (likes, partages, commentaires) et les mécanismes de récompense intégrés par les plateformes favorisent le développement de comportements addictifs. Voir à ce sujet un précédent article

- Exposition aux contenus toxiques : Désinformation, discours de haine, harcèlement… Les adolescents peuvent facilement se retrouver confrontés à des publications choquantes sans disposer des clés pour s’en prémunir.

- Isolement et détresse psychologique : La comparaison sociale permanente, accentuée par l’ultra-connexité, peut générer de l’anxiété, un manque de confiance en soi et, parfois, des épisodes dépressifs.

Cyberharcèlement et nouvelles formes de violence

La réduction de la modération sur des plateformes comme X peut contribuer à la hausse du cyberharcèlement et des comportements à risque :

- Pression du groupe et harcèlement de masse : Les “raids” numériques ou le doxxing (publication de données personnelles) peuvent détruire la réputation d’un jeune en quelques heures.

- Nouvelles plateformes et défis dangereux : Chaque mois, de nouveaux réseaux ou de nouvelles tendances émergent. On voit apparaître régulièrement des “challenges” encourageant des comportements à risques (mise en scène de violences, automutilation, etc.).

- « Revenge porn » et sexting : Particulièrement préoccupants, ces phénomènes illustrent la difficulté pour la jeunesse à maîtriser la confidentialité de ses contenus privés en ligne. Voir un précédent article à ce sujet

Comment mieux prévenir et protéger les jeunes ?

- Renforcer l’éducation numérique :

- À l’école : Inclure des programmes d’apprentissage critique des médias et du fonctionnement des algorithmes.

- À la maison : Les parents doivent discuter régulièrement des contenus auxquels leurs enfants sont exposés, enseigner les bonnes pratiques (choisir des mots de passe forts, paramètres de confidentialité, etc.). Ils doivent également montrer le bon exemple à leurs enfants qui imitent bien plus les adultes qu'ils ne les écoutent.

- Initier un dialogue intergénérationnel :

- Parents – enfants : Pour briser la méfiance et inciter à la transparence, il est essentiel d’aborder les sujets sensibles (harcèlement, pornographie, contenus violents) sans tabou.

- École – famille : Les enseignants, psychologues et responsables associatifs peuvent former un réseau de soutien pour détecter et prendre en charge rapidement les situations à risque.

- Encourager des pratiques de « déconnexion » :

- Activités hors-ligne : Sport, arts, sorties culturelles… Autant d’occasions de se construire une vie sociale hors des écrans.

- Gestion du temps d’écran : Instaurer des plages horaires sans téléphone (durant les repas, avant le coucher) pour réduire les risques d'addiction et favoriser un sommeil de qualité. Et peut-être participer à notre Digitale Challenge.

- Responsabiliser les plateformes :

- Exiger une meilleure transparence : Publication régulière de rapports sur la modération, conditions d’utilisation claires et cohérentes.

- Mettre en place des outils de signalement plus efficaces : Les réseaux sociaux doivent simplifier le processus de signalement et renforcer les sanctions contre les comptes qui enfreignent les règles.

- Sensibiliser aux risques juridiques :

- Sexting et partage de contenus intimes : Les adolescents doivent être conscients que la diffusion non consentie de photos ou vidéos est illégale et sévèrement punie par la loi.

- Harcèlement en ligne : Il ne s’agit pas d’un “jeu” ; les insultes, menaces et actes de vengeance virtuels peuvent mener à des poursuites judiciaires.

Un équilibre à trouver entre liberté et responsabilité

Avec l’arrivée de Trump au pouvoir en 2024, la vision d’une « liberté d’expression » sans limite continue de polariser les débats. Les décisions d’Elon Musk avec X, ainsi que les orientations de Mark Zuckerberg chez Meta, dessinent un futur numérique encore plus complexe, où la frontière entre information et désinformation est souvent floue.

Dans ce contexte, l’enjeu principal demeure la protection de la jeunesse. Entre addiction aux écrans, risques de cyberharcèlement et exposition à des contenus toxiques, il est impératif de développer une éducation numérique solide, un dialogue permanent et des outils de prévention adaptés. Nous apportons quelques éléments à travers notre plateforme digihamo.ch.

Les législations, en perpétuelle évolution, et les avancées technologiques (IA, nouveaux modes de modération) peuvent contribuer à rendre ces espaces plus sûrs. Reste à savoir si cette régulation trouvera un équilibre satisfaisant entre la nécessaire liberté d’expression et la protection des publics les plus vulnérables, notamment les jeunes. L’avenir des réseaux sociaux se jouera très certainement dans cette quête de responsabilité partagée.